Trinity ESE

Epistemic Systems Engineering (ESE) to autorska dyscyplina inżynieryjna zajmująca się projektowaniem, walidacją i wdrażaniem systemów decyzyjnych, w których rygor epistemiczny jest właściwością architektury, a nie cechą użytkownika, modelu sztucznej inteligencji ani pojedynczej treści informacyjnej.

Diagnoza epistemiczna współczesnych środowisk decyzyjnych

Punktem wyjścia ESE jest rozpoznanie strukturalnej niewystarczalności tradycyjnych arbitrów prawdziwości we współczesnych środowiskach wysokiej złożoności, charakteryzujących się:

- Nadmiarem informacji przekraczającym możliwości przetwarzania

- Nieliniowymi zależnościami przyczynowymi

- Probabilistycznymi źródłami wiedzy

W tych warunkach zarówno człowiek, jak i systemy AI są strukturalnie niezdolne do pełnienia roli autonomicznych gwarantów prawdziwości:

- Człowiek podlega systematycznym heurystykom i zniekształceniom poznawczym udokumentowanym w psychologii poznawczej

- Modele generatywne operują na rozkładach prawdopodobieństwa, produkując symulacje wiedzy w oparciu o wzorce statystyczne, nie wiedzę weryfikowalną metodami epistemicznymi

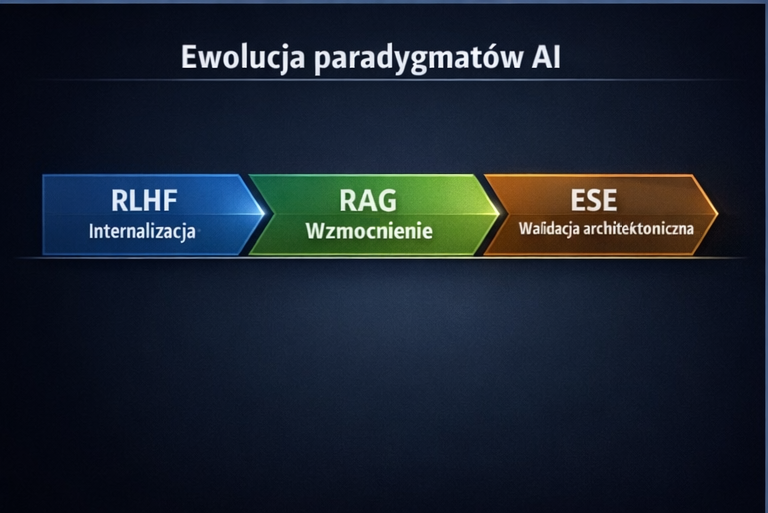

Odwrócenie paradygmatu: od trenowania modelu do walidacji architektury

ESE stanowi fundamentalne odwrócenie dominującego paradygmatu rozwoju systemów AI, reprezentowanego przez podejścia takie jak RLHF (Reinforcement Learning from Human Feedback) i RAG (Retrieval-Augmented Generation).

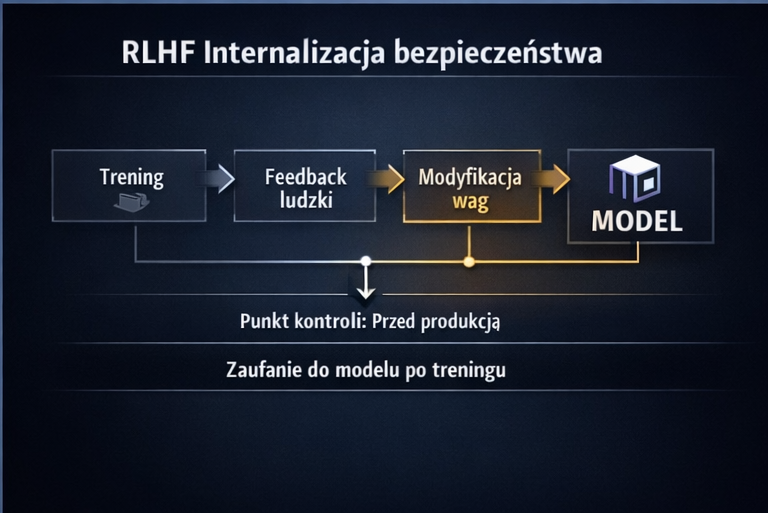

Paradygmat tradycyjny: RLHF (internalizacja bezpieczeństwa)

W paradygmacie RLHF:

- Odpowiedzialność epistemiczna jest internalizowana w modelu poprzez proces uczenia

- Weryfikacja ludzka służy jako sygnał treningowy do modyfikacji wag modelu

- Cel: wytrenować model, który sam będzie generował epistemicznie poprawne odpowiedzi

- Założenie: możliwe jest nauczenie modelu „poprawnego myślenia” przez optymalizację parametrów

- Punkt interwencji: faza przedprodukcyjna (trening, dostrajanie, wyrównanie)

- Mechanizm kontroli: wewnętrzny (zniekształcenie rozkładu prawdopodobieństwa modelu)

Konsekwencja: System traktuje wytrenowany model jako źródło zaufania. Użytkownik otrzymuje odpowiedź z założeniem, że proces treningowy zapewnił jej poprawność.

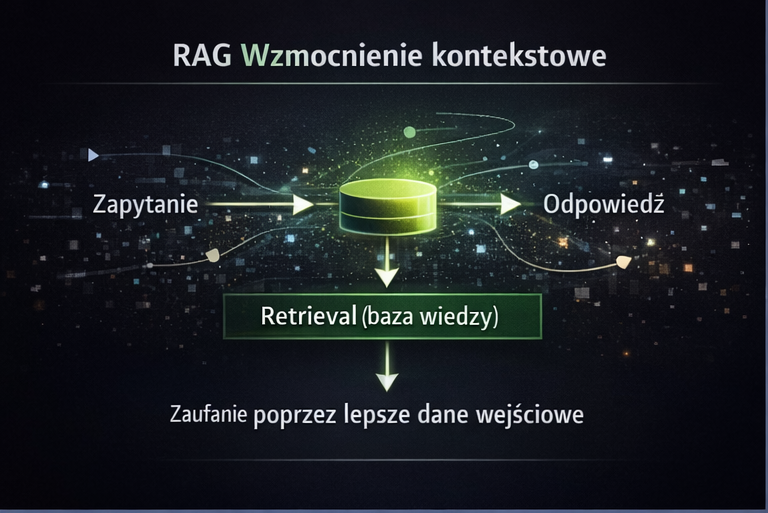

Paradygmat hybrydowy: RAG (wzmocnienie kontekstowe)

RAG powstał jako odpowiedź na ograniczenia RLHF i problem halucynacji modeli językowych. Podejście RAG:

- Wzbogaca zapytanie o zewnętrzny kontekst pobrany z bazy wiedzy (retrieval)

- Uziemia generację w zweryfikowanych dokumentach

- Zwiększa prawdopodobieństwo poprawności odpowiedzi przez dostarczenie faktów

- Punkt interwencji: faza generacji (w trakcie działania, przed wywołaniem modelu)

- Mechanizm kontroli: kontekstowy (rozszerzenie dostępnej informacji)

Charakterystyka RAG:

- Działa jako warstwa nad modelami generatywnymi

- Poprawia jakość odpowiedzi przez wzmocnienie danych wejściowych

- Znajduje zastosowanie w środowiskach korporacyjnych wymagających zakotwiczenia w dokumentach

- Nie mierzy formalnie pewności ani ryzyka odpowiedzi

- Zakłada, że model z lepszym kontekstem da lepszą odpowiedź

Logika RAG: „Model prawdopodobnie ma rację, jeśli ma dostęp do poprawnych danych”

Paradygmat ESE: architektoniczna walidacja zewnętrzna

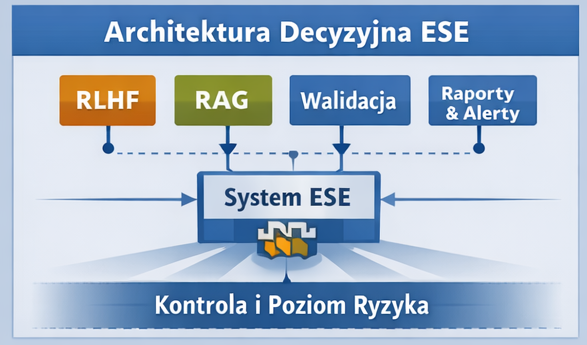

W paradygmacie ESE (realizowanym przez systemy Trinity):

- Odpowiedzialność epistemiczna jest wynoszona poza model do warstwy architektonicznej

- Weryfikacja nie modyfikuje modelu ani jego wejścia, lecz waliduje wyjście w momencie użycia

- Cel: zaprojektować system, który wykrywa epistemiczną niestabilność niezależnie od jakości modelu lub kontekstu

- Założenie: żaden model nie jest gwarantem prawdziwości — weryfikacja musi być zewnętrzna i ciągła

- Punkt interwencji: faza produkcyjna (w trakcie działania, po wygenerowaniu odpowiedzi)

- Mechanizm kontroli: zewnętrzny (wielowarstwowa walidacja niezależna od architektury modelu)

Charakterystyka ESE (Trinity): Zamiast wzmacniać model dodatkowymi danymi (RAG) lub modyfikować jego parametry (RLHF), ESE:

- Generuje wiele wariantów odpowiedzi (konfrontacja perspektyw)

- Wymusza konfrontację między niezależnymi modelami

- Analizuje spójność semantyczną i logiczną odpowiedzi

- Przypisuje mierzalny poziom ryzyka epistemicznego poprzez ORS (Output Rigor Score) — syntetyczną metrykę rygoru epistemicznego wyjścia, niebędącą miarą prawdziwości ani pewności, lecz wskaźnikiem stabilności i ryzyka epistemicznego

- Dostarcza formalną klasyfikację decyzji poprzez TRL (Tolerancja Ryzyka Logicznego) — formalną klasyfikację dopuszczalności użycia odpowiedzi jako podstawy decyzji, wyznaczającą próg akceptacji, eskalacji lub blokady

- Zapewnia pełną ścieżkę audytu każdej decyzji

- Może działać nad dowolnym modelem językowym, w tym systemami opartymi na RAG

Logika ESE: „Decyzja została poddana formalnej walidacji i ma mierzalny poziom ryzyka epistemicznego”

Konsekwencja: System traktuje każdą odpowiedź modelu jako epistemicznie podejrzaną do momentu przejścia przez walidację. Model pozostaje „czarną skrzynką”, ale jego wyjście podlega systematycznej weryfikacji.

Porównanie trzech paradygmatów

| Wymiar | RLHF | RAG | ESE (Trinity) |

|---|---|---|---|

| Natura interwencji | Modyfikacja modelu | Wzmocnienie kontekstu | Walidacja wyjścia |

| Punkt zaufania | Model (po treningu) | Model + dane zewnętrzne | Architektura walidacyjna |

| Moment kontroli | Przed wdrożeniem | Przed generacją | Po wygenerowaniu |

| Typ poprawy | Parametry modelu | Jakość wejścia | Kontrola decyzji |

| Miara ryzyka | Brak | Brak | Ilościowa (ORS) |

| Audytowalność | Niska | Średnia | Pełna |

| Klasyfikacja decyzji | Brak | Brak | Formalna (TRL) |

| Wykrywanie halucynacji | Probabilistyczne | Ograniczone | Systematyczne |

| Działanie w środowisku regulowanym | Ograniczone | Częściowe | Projektowane |

| Koszt błędu | Systemowy | Zmniejszony | Lokalny (blokada) |

Relacja między podejściami: komplementarność w architekturze korporacyjnej

Kluczowe rozróżnienie funkcjonalne:

- RAG jest mechanizmem poprawy generacji — dostarcza lepszy kontekst

- ESE jest warstwą kontroli decyzyjnej — weryfikuje czy wynik może stać się podstawą działania

W architekturze korporacyjnej przyszłości mogą współistnieć:

- RLHF → dostarcza model bazowy wyrównany do preferencji ludzkich

- RAG → wzbogaca generację o aktualny kontekst i dane domenowe

- ESE (Trinity) → kontroluje, czy wynik (nawet wzmocniony przez RAG) może stać się decyzją operacyjną

Przykład przepływu:

Zapytanie użytkownika

↓

RAG: pobranie kontekstu z bazy wiedzy

↓

Model (wyrównany przez RLHF): generacja odpowiedzi

↓

Trinity (ESE): walidacja wielowarstwowa

↓

• Konfrontacja z innymi modelami

• Analiza stabilności semantycznej

• Obliczenie ORS (ryzyko epistemiczne)

• Klasyfikacja TRL (próg akceptacji)

↓

Decyzja: AKCEPTUJ / ESKALUJ / ODRZUĆ

↓

Działanie operacyjnePozycjonowanie ESE w ewolucji systemów AI

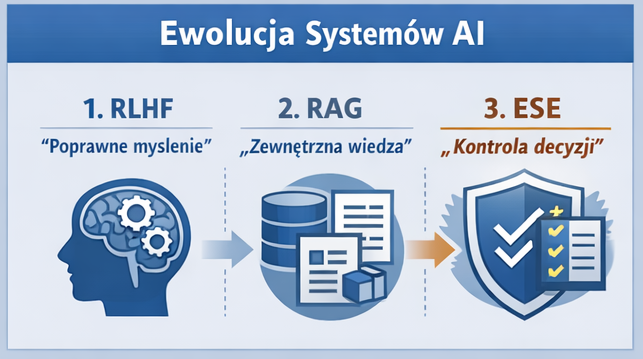

Jeżeli:

- RLHF reprezentuje pierwszą generację — próbę nauczenia modelu „poprawnego myślenia”

- RAG reprezentuje drugą generację — wzmocnienie modelu zewnętrzną wiedzą

To ESE reprezentuje trzecią generację:

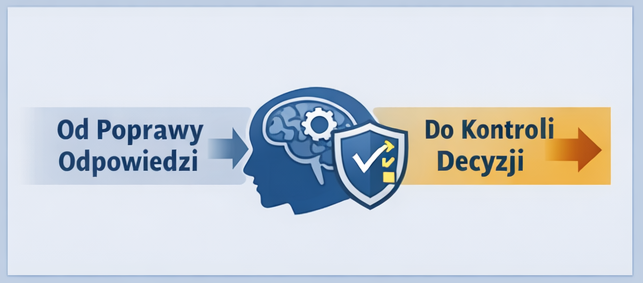

- Przejście od poprawiania odpowiedzi do kontrolowania decyzji

- Przejście od zwiększania prawdopodobieństwa poprawności do mierzalnej kwantyfikacji ryzyka epistemicznego

- Przejście od narzędzi wspierających modele językowe do infrastruktury decyzyjnej klasy korporacyjnej

Konsekwencja strategiczna

ESE nie konkuruje z RLHF ani RAG — wykorzystuje je jako komponenty w szerszej architekturze kontroli decyzyjnej.

Przewaga ESE nad RAG:

| Wymiar | RAG | ESE |

|---|---|---|

| Cel | Zwiększa trafność odpowiedzi | Wprowadza kontrolę nad decyzją |

| Miara jakości | Jakościowa (lepszy kontekst) | Ilościowa (miara ryzyka) |

| Audyt | Ograniczony (źródła dokumentów) | Pełny (cała ścieżka walidacji) |

| Integracja z przepisami | Częściowa | Projektowana |

| Klasyfikacja ryzyka | Brak | Formalna (TRL, ORS, PKF) |

| Możliwość eskalacji | Ręczna | Systemowa |

| Działanie nad RAG | Nie | Tak (może walidować wyjście RAG) |

To przesuwa ESE:

- Z kategorii narzędzi poprawy jakości AI

- Do kategorii infrastruktury kontroli decyzyjnej dla środowisk wysokiego ryzyka

Architektoniczne przesunięcie odpowiedzialności epistemicznej

ESE wprowadza fundamentalne przesunięcie odpowiedzialności: od jednostkowego podmiotu (człowieka lub modelu) do systemu, który wymusza proces weryfikacji jako integralny, nieomijany element przepływu informacji i podejmowania decyzji.

Zasady konstrukcyjne ESE

W ujęciu ESE obowiązują następujące założenia projektowe:

- Neutralność generacyjna: Akt wygenerowania treści — niezależnie od źródła (człowiek, algorytm, ekspercka analiza) i metody wzbogacenia (RAG, dostrajanie) — jest epistemicznie neutralny i nie nadaje treści statusu wiedzy

- Jawność statusu epistemicznego: Status epistemiczny każdej treści (wiedza zweryfikowana, hipoteza robocza, opinia, interpretacja, symulacja probabilistyczna) musi zostać jawnie zidentyfikowany i oznaczony

- Warunkowa legitymacja decyzyjna: Legitymacja treści jako podstawy decyzji wynika wyłącznie z przejścia przez zaprojektowane warstwy walidacyjne, nie z autorytetu źródła, jakości kontekstu, spójności narracyjnej ani pozornej pewności

Separacja generowania od akceptacji

ESE konsekwentnie oddziela fazę generowania treści od fazy jej akceptacji epistemicznej, traktując wiedzę nie jako produkt końcowy ani stan posiadania, lecz jako wynik kontrolowanego procesu walidacyjnego obejmującego:

- Wielowarstwową walidację z niezależnymi mechanizmami kontrolnymi

- Triangulację metodologiczną (konfrontacja różnych perspektyw i narzędzi)

- Systematyczne porównanie alternatywnych hipotez

- Analizę warunków brzegowych i obszarów nierozstrzygalności

- Kwantyfikację ryzyka epistemicznego

Zasada fundamentalna: Treść, która nie przeszła zaprojektowanego procesu walidacyjnego, nie może zostać użyta jako podstawa działania — niezależnie od jej spójności wewnętrznej, estetyki prezentacji, konsensusu społecznego, jakości źródeł (RAG) czy autorytetu modelu (RLHF).

Tarcie epistemiczne jako warstwa bezpieczeństwa

Kluczowym elementem ESE jest świadomie zaprojektowane tarcie epistemiczne — systemowy opór wprowadzany między generacją treści a jej użyciem jako podstawy decyzji.

Tarcie epistemiczne nie stanowi:

- Defektu projektowego wymagającego optymalizacji

- Kosztu ubocznego do minimalizacji

- Przeszkody w efektywności operacyjnej

Tarcie epistemiczne stanowi natomiast:

- Warstwę bezpieczeństwa epistemicznego analogiczną do redundancji w systemach krytycznych, bezpieczników w inżynierii elektrycznej czy protokołów weryfikacyjnych w medycynie

- Mechanizm wykrywania błędu zwiększający prawdopodobieństwo wykrycia niespójności, niestabilności lub halucynacji przed ich materializacją w działaniu

- Architektoniczny wymóg systemów operujących w środowiskach wysokiego ryzyka

Cel i zakres ESE

ESE świadomie nie dąży do:

- Ustalenia prawdy ontologicznej (co jest rzeczywiste)

- Całkowitej eliminacji błędu poznawczego

- Osiągnięcia pewności epistemicznej

ESE uznaje te cele za nieosiągalne w środowiskach probabilistycznych i złożonych.

Rzeczywisty cel ESE to zapobieganie nieświadomemu użyciu epistemicznie niestabilnej lub niezweryfikowanej treści jako podstawy decyzji wysokiego ryzyka, poprzez projektowanie systemów które:

- Blokują decyzje oparte na treściach o nieznanym, nieoznaczonym lub niezweryfikowanym statusie epistemicznym

- Rozdzielają konsensus od prawdy, rozpoznając że zgodność perspektyw nie jest dowodem poprawności (problem fałszywego konsensusu)

- Umożliwiają świadome wstrzymanie działania w warunkach epistemicznej nierozstrzygalności, traktując wstrzymanie decyzji jako racjonalną odpowiedź na brak wystarczających podstaw

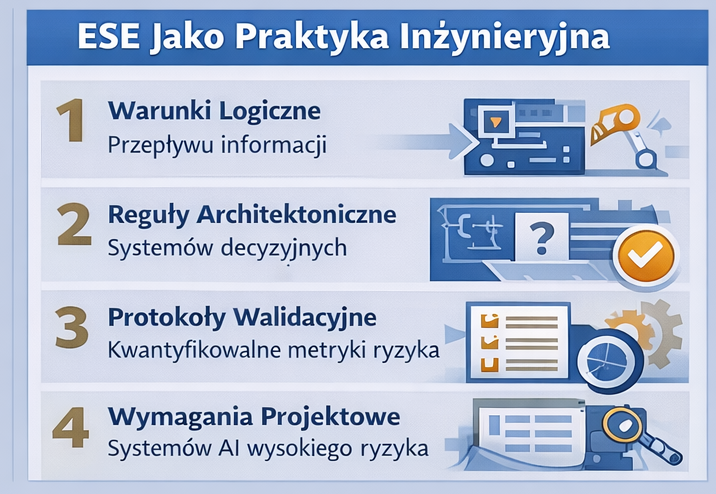

ESE jako praktyka inżynieryjna

Epistemic Systems Engineering nie jest:

- Epistemologią teoretyczną ani filozofią poznania

- Zbiorem zasad krytycznego myślenia

- Metodologią badań naukowych

- Etyką informacyjną

ESE jest praktyką inżynieryjną, w której rozróżnienia filozoficzne i wnioski z nauk poznawczych zostają przekształcone w:

- Warunki logiczne przepływu informacji

- Reguły architektoniczne systemów decyzyjnych

- Protokoły walidacyjne z kwantyfikowalnymi metrykami ryzyka

- Wymagania projektowe dla systemów AI działających w środowiskach wysokiego ryzyka

Kryterium wadliwości projektowej: System, który pozwala na podjęcie decyzji na podstawie treści o nieokreślonym lub niezweryfikowanym statusie epistemicznym, jest w paradygmacie ESE systemem wadliwym projektowo — niezależnie od kompetencji jego użytkowników, zaawansowania technologii, jakości modeli bazowych (RLHF) czy wzbogacenia kontekstu (RAG).

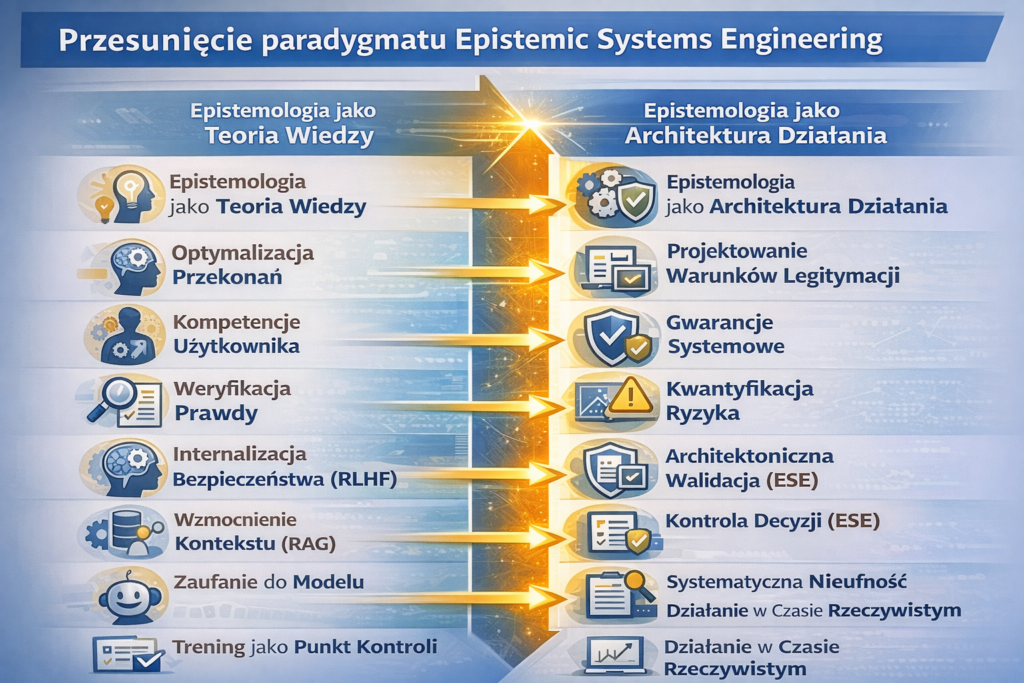

Przesunięcie paradygmatu

Epistemic Systems Engineering to przejście:

- Od epistemologii jako teorii wiedzy → do epistemologii jako architektury odpowiedzialnego działania

- Od optymalizacji przekonań → do projektowania warunków legitymacji decyzyjnej

- Od kompetencji użytkownika → do gwarancji systemowych

- Od weryfikacji prawdy → do kwantyfikacji ryzyka epistemicznego

- Od internalizacji bezpieczeństwa w modelu (RLHF) → do architektonicznej walidacji zewnętrznej (ESE)

- Od wzmocnienia kontekstu (RAG) → do kontroli decyzji (ESE)

- Od zaufania do modelu → do systematycznej nieufności z wymogiem weryfikacji

- Od treningu jako punktu kontroli → do działania w czasie rzeczywistym jako punktu kontroli

- Od poprawiania odpowiedzi → do kontrolowania decyzji

W tym sensie ESE stanowi odpowiedź inżynieryjną na fundamentalną zmianę środowiska decyzyjnego: gdy źródła informacji stają się probabilistyczne, nieliniowe i przekraczają możliwości ludzkiej weryfikacji, odpowiedzialność za rygor epistemiczny musi zostać przeniesiona z podmiotu (i modelu) do architektury systemu, która działa niezależnie od jakości modelu, kontekstu czy procesu treningowego.