Trinity: Wielomodelowa Walidacja AI dla Kluczowych Sektorów Biznesu

W dobie powszechnej implementacji sztucznej inteligencji, największym wyzwaniem nie jest już sama generacja treści, lecz ich wiarygodność. Pojedyncze modele AI, choć sprawne, posiadają krytyczną wadę: generują odpowiedzi z całkowitą pewnością siebie, nawet gdy halucynują lub operują na nieaktualnych danych.

Trinity to zaawansowany system orkiestracji i walidacji, który rozwiązuje ten problem poprzez konfrontację wielu niezależnych modeli AI w czasie rzeczywistym. Zamiast polegać na jednej opinii, Trinity działa jak konsylium ekspertów: wykrywa rozbieżności, identyfikuje błędy i klasyfikuje pewność każdej analizy za pomocą obiektywnego wskaźnika ORS (Objective Rigor Score).

Dlaczego Trinity?

- Eliminacja halucynacji i błędów: System wykrywa „fałszywy konsensus” i krytyczne rozbieżności, zanim wpłyną one na decyzje biznesowe lub bezpieczeństwo pacjentów.

- Pełna audytowalność: Każda decyzja Trinity posiada zapisaną ścieżkę audytu, co pozwala na pełną zgodność z regulacjami takimi jak FDA, MiFID II, RODO czy NIST.

- Wymierna oszczędność i bezpieczeństwo: Od redukcji kosztów audytów ESG, po ochronę budżetów inwestycyjnych i redukcję fałszywych alarmów w cyberbezpieczeństwie.

Poniżej znajduje się szczegółowe zestawienie zastosowań systemu Trinity w kluczowych obszarach: od medycyny i finansów, po prawo, HR i cyberbezpieczeństwo.

Problem: wąskie gardło między AI a decyzją

W klasycznym modelu pracy z AI odpowiedź dużego modelu językowego trafia bezpośrednio do człowieka, który musi ją ręcznie ocenić. To właśnie ten moment staje się krytycznym wąskim gardłem całego systemu.

LLM generuje treść, ale nie dostarcza mierzalnej pewności, śladu rozumowania ani obiektywnej informacji o ryzyku błędu. Człowiek zostaje zmuszony do intuicyjnej oceny: czy odpowiedź jest poprawna, kompletna i bezpieczna do użycia. Ta walidacja jest subiektywna, nieskalowalna i podatna na zmęczenie oraz bias poznawczy.

W efekcie AI nie może działać jako system decyzyjny — pozostaje jedynie narzędziem pomocniczym. Każda decyzja o realnych konsekwencjach wymaga ręcznego nadzoru, co blokuje automatyzację i audytowalność.

To nie model jest ograniczeniem.

Ograniczeniem jest brak warstwy zaufania między odpowiedzią AI a decyzją.

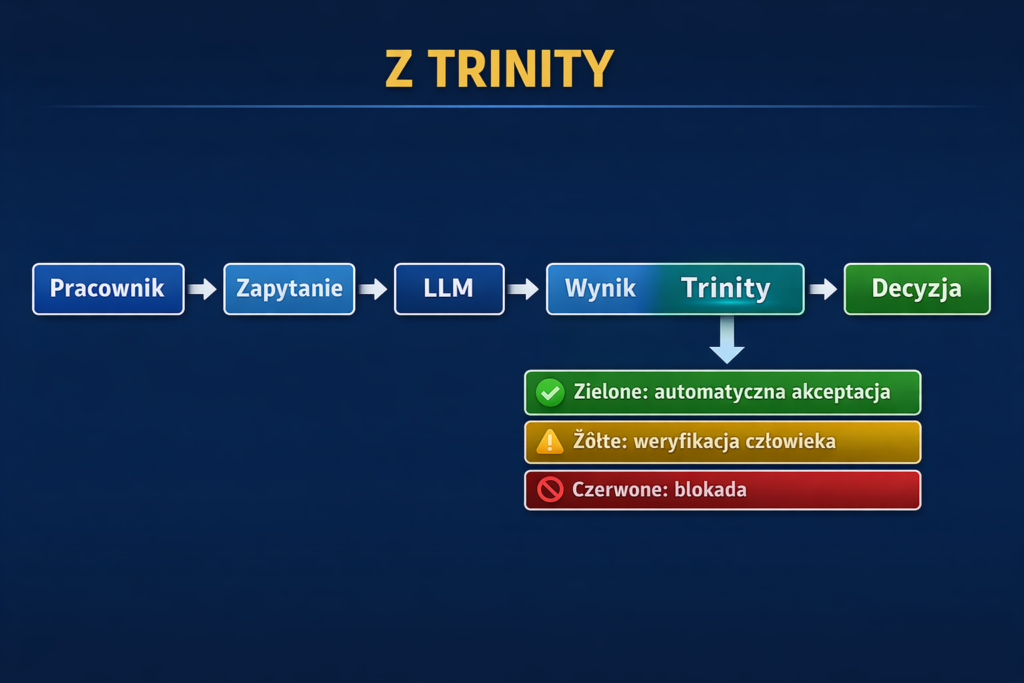

Model decyzyjny z Trinity

W architekturze z Trinity odpowiedź generowana przez LLM nie jest bezpośrednio wykorzystywana w procesie decyzyjnym. Zostaje ona przechwycona przez warstwę Trinity, która pełni funkcję systemowej kontroli zaufania i ryzyka.

Trinity ocenia wynik modelu w sposób formalny i deterministyczny, przypisując go do jednego z trzech stanów decyzyjnych:

zielony — automatyczna akceptacja i przejście do decyzji,

żółty — eskalacja do weryfikacji człowieka,

czerwony — blokada użycia wyniku.

Dzięki temu odpowiedzialność decyzyjna zostaje przeniesiona z intuicyjnej oceny człowieka na zaprojektowaną warstwę epistemiczną. Człowiek wchodzi w proces wyłącznie tam, gdzie jest to uzasadnione ryzykiem, co eliminuje wąskie gardło, zwiększa skalowalność oraz umożliwia audytowalne i bezpieczne użycie AI w środowiskach krytycznych.

Trinity jako warstwa infrastrukturalna

Diagram przedstawia Trinity jako pośrednią, infrastrukturalną warstwę epistemiczną pomiędzy aplikacjami biznesowymi a warstwą modeli AI. Systemy takie jak CRM, ERP, CMS czy rozwiązania prawne i medyczne nie komunikują się bezpośrednio z modelami językowymi, lecz korzystają z Trinity jako stabilnego interfejsu decyzyjnego.

Warstwa Trinity-ICL / OS-Trinity odpowiada za formalizację zaufania do odpowiedzi AI poprzez cztery kluczowe mechanizmy: konsensus, rygor, ocenę źródeł oraz ocenę wyniku. Dzięki temu niezależnie od tego, czy backendem jest GPT, Claude, Gemini, Llama, Mistral czy Grok, system otrzymuje ustandaryzowaną, audytowalną i porównywalną informację decyzyjną.

W efekcie Trinity oddziela logikę biznesową od zmienności modeli AI, umożliwiając bezpieczną wymienność modeli, skalowanie oraz zastosowanie AI w środowiskach regulowanych i wysokiego ryzyka bez utraty kontroli epistemicznej.